C’è stato un momento in cui l’intelligenza artificiale, nella musica, sembrava destinata a restare sullo sfondo. Oggi quello sfondo si è spostato in avanti.

La domanda non è più se questi sistemi siano capaci di generare suoni credibili, ma quanto a lungo sapremo ancora distinguere un risultato convincente da un’intenzione musicale reale.

Dalla diffidenza alla curiosità

Per molto tempo ho guardato con una certa distanza all’intelligenza artificiale applicata alla composizione. Non per rifiuto ideologico, ma per abitudine professionale. Mi interessava per ciò che poteva fare bene senza invadere il terreno creativo: ripulire file audio, ridurre rumori, velocizzare interventi tecnici che normalmente richiedono tempo e pazienza.

Poi sono arrivati i primi ascolti condivisi da colleghi e amici. Brani completi, voci sintetiche, arrangiamenti già confezionati. Li affrontavo con attenzione, ma anche con quello scetticismo che viene naturale quando si lavora ogni giorno con il suono. Cercavo il punto in cui il meccanismo si incrinava.

Nella maggior parte dei casi quel punto arrivava presto. Una progressione armonica troppo rigida, una distribuzione delle parti poco naturale, un suono corretto ma senza profondità. C’era precisione, ma non ancora una vera idea musicale capace di reggere l’ascolto.

Quando si sente una scelta

A un certo punto, però, mi sono fermato su un file in modo diverso dagli altri. Non perché fosse perfetto, né perché rappresentasse un salto tecnologico clamoroso. Mi ha colpito per una ragione più semplice: lì dentro si sentiva una scelta.

Era un brano pop, niente di particolarmente complesso. Ma il timbro della voce non sembrava il risultato casuale di un generatore. Aveva una coerenza interna, un colore pensato, una tenuta che cambiava nell’estensione senza diventare caricaturale. Per la prima volta non stavo ascoltando solo un risultato tecnico convincente. Stavo ascoltando una decisione.

In quel momento il discorso ha smesso di sembrarmi teorico. Ho capito che il punto non era soltanto cosa fosse in grado di fare l’algoritmo, ma chi lo stava guidando. Quando dietro c’è un orecchio competente, l’intelligenza artificiale smette di essere una curiosità tecnica e diventa un’estensione del processo creativo.

La prova diretta

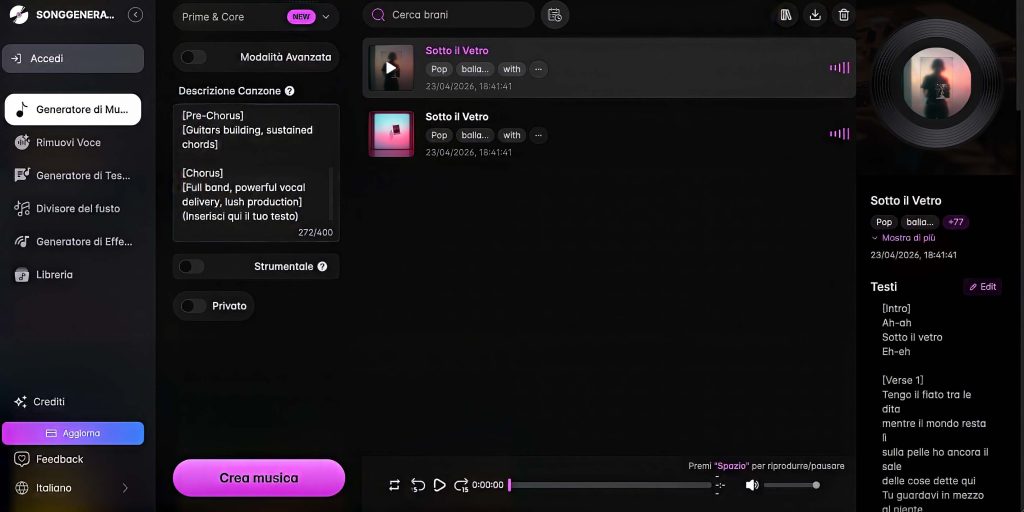

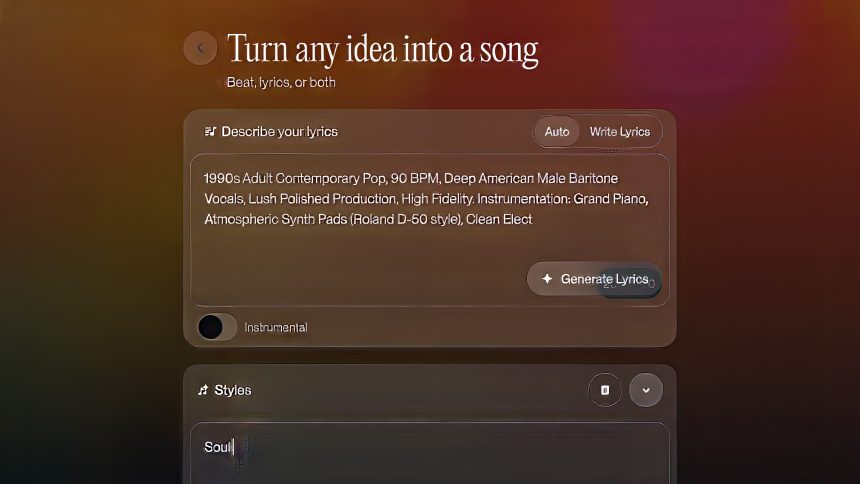

Per questo ho deciso di provarla direttamente. Non con l’idea di delegare la scrittura musicale a una piattaforma, ma per capire meglio dove finisce il mezzo e dove comincia l’intervento umano.

Ho lavorato soprattutto su brani pop, perché in questo momento è uno dei terreni in cui questi sistemi riescono a dare risultati più credibili. La struttura è più controllabile, il numero di elementi in gioco è inferiore e quindi anche il margine d’errore risulta meno evidente. In alcuni casi il risultato restava debole, in altri sorprendentemente utilizzabile.

Con l’orchestrale, invece, i limiti emergevano quasi subito. Non tanto per una questione di quantità, ma di organizzazione interna. C’erano troppi elementi che occupavano spazio nello stesso momento, poca gerarchia, poca respirazione tra le parti. A un primo ascolto poteva sembrare ricco; ascoltato meglio, risultava spesso saturo e statico.

È una differenza che chi lavora con l’arrangiamento percepisce subito. Un’orchestra reale non è soltanto somma di strumenti: è equilibrio, movimento, relazione continua tra pieni, vuoti e dinamiche. Ed è proprio lì che, almeno per ora, molti sistemi automatici mostrano il loro limite.

Dove l’intervento umano fa la differenza

La parte più interessante arriva dopo la generazione. Quando il materiale può essere esportato in tracce separate e rielaborato in studio, il risultato cambia molto. Missaggio, trattamento dinamico, interventi timbrici, outboard analogico: nelle mani giuste, basta poco per rendere meno evidenti molte rigidità tipiche di una produzione artificiale.

Questo non significa che l’intelligenza artificiale lavori da sola. Significa, piuttosto, il contrario. Più il risultato finale sembra credibile, più spesso dietro c’è qualcuno che sa dove mettere le mani. Chi immagina che basti scrivere una richiesta generica per ottenere musica davvero convincente sottovaluta tutto ciò che accade dopo: selezione, correzione, pulizia, ascolto critico.

Ed è qui che il discorso diventa più interessante. La qualità non dipende soltanto dal software, ma dalla competenza di chi lo usa. Un sistema può generare materiale, ma non può ancora sostituire davvero quella sensibilità che riconosce quando una nota è formalmente corretta ma musicalmente fuori posto.

Il problema dell’ascolto contemporaneo

C’è poi un aspetto che, personalmente, trovo ancora più significativo dell’evoluzione tecnica: il modo in cui ascoltiamo. Oggi moltissima musica passa attraverso dispositivi e piattaforme che riducono le differenze, comprimono le dinamiche e appiattiscono una parte importante delle sfumature. Questo modifica il nostro rapporto con il suono più di quanto sembri.

Dettagli come la distanza tra gli strumenti, le piccole variazioni timbriche, il modo in cui una voce si muove nello spazio del mix diventano meno percepibili. E quando questi dettagli si perdono, diventa più difficile distinguere ciò che è solo ben costruito da ciò che è davvero vivo.

Forse è qui che si gioca la parte più delicata della questione. Non solo nella capacità delle macchine di imitare meglio la musica umana, ma nella nostra capacità di continuare ad ascoltare in profondità. Se quel livello di attenzione si riduce, anche la differenza tra un brano generato e uno nato da un gesto musicale reale rischia di diventare meno evidente.

Conclusione

Dopo molte prove, ascolti e confronti, la sensazione che mi resta non è di allarme, ma di ridefinizione. L’intelligenza artificiale può già produrre materiali sorprendenti e, in alcuni contesti, diventare uno strumento estremamente efficace. Ma la musica, almeno per ora, continua a rivelarsi altrove: nelle sfumature che non chiedono di essere notate subito, nei piccoli scarti, nella respirazione interna del suono.

Più che chiederci se l’autore resterà umano, dovremmo capire se sapremo restare umani nell’ascolto.

Alla prossima puntata sul mondo dell’AI

Capisco perfettamente il punto. È affascinante come l’IA stia cambiando radicalmente il modo in cui percepiamo la musica, e la distinzione tra creazione artificiale e intenzionalità artistica diventa sempre più sfumata.

Passo le mie giornate tra l’ascolto clinico e quello musicale, e quello che hai scritto mi ha colpito perché non sa di teoria. Sa di roba vera, di quella che riconosci subito.

Leggendoti ho avuto la sensazione di parlare con qualcuno che sta davvero ascoltando, non solo analizzando. E oggi non è affatto scontato.

Il punto sulla “scelta” è quello che mi ha preso di più. È lì che cambia tutto. Finché senti un risultato puoi giudicarlo: giusto, sbagliato, credibile o finto. Ma quando percepisci una scelta, ti fermi! Anche se è imperfetta, capisci che lì dentro qualcuno ha deciso qualcosa. E quel gesto ha un senso.

L’AI oggi può fare tante cose fatte bene, ma quella direzione interna non ce l’ha. Serve qualcuno che sappia dove andare. Sempre.

Mi sono ritrovato molto anche su quello che dici dell’orchestrale. Quella ricchezza un po’ finta, piena ma ferma. Al primo impatto può impressionare, ma dopo pochi secondi senti che manca l’aria, manca il respiro. E quella roba non la aggiungi con un algoritmo: la costruisci con l’esperienza, con gli errori, con l’orecchio.

Però il punto più grosso l’hai centrato alla fine. La partita vera si gioca sull’ascolto. Se perdiamo l’attenzione ai dettagli e tutto diventa consumo veloce, allora sì che la differenza si assottiglia. Ma non perché l’AI è diventata “umana”: è che noi rischiamo di ascoltare meno da umani.

Il rischio non è che le macchine diventino troppo brave, è che noi diventiamo meno esigenti.

Il bello del tuo pezzo è che non sei né “pro” né “contro”. Sei dentro la cosa, con gli strumenti per capirla. Continua a scrivere, perché quando si parla di musica con questa testa vale sempre la pena fermarsi a leggere.

Nicola Tancredi

Studio di registrazione suonoro