Al giorno d’oggi si sente parlare sempre meno di Computer Music, spesso confusa con la musica elettronica. Ma precisamente, qual è la differenza?

Con quest’ultima si intende l’uso esclusivo di suoni sintetici, prodotti da oscillatori elettrici, che generano effetti sonori, come il rumore bianco. Al contrario la Computer Music, è uno stile musicale basato sull’uso di elaboratori elettronici. Nell’ultimo periodo è cambiato totalmente il modo di comporre, eseguire e riprodurre la musica. Pertanto in questo articolo analizzeremo nello specifico, la storia della Computer Music, con i suoi maggiori esponenti, e le tappe che hanno contribuito al suo cambiamento sino ad oggi.

CHE COS’È LA COMPUTER MUSIC

Iniziamo con il dire che la computer music o musica informatica è un ramo della musica elettroacustica (genere contemporaneo, che utilizza tecniche di registrazione dei suoni e di sintesi sonora), che impiega la programmazione su elaboratore numerico. In senso più esteso, qualunque produzione musicale che utilizzi un mezzo informatico può definirsi computer music. Essa nasce intorno al 1963 con la pubblicazione sulla famosa rivista americana “Science” dell’articolo “The digital computer as a musical instrument” di Max Mathews. La produzione musicale è esclusivamente basata sull’utilizzo del computer, delle periferiche audio, sequencer audio/MIDI, plug-in VST, AU, RTAS, campionatori software e librerie di campioni. Lo stile ebbe quale maggiore rappresentante Iannis Xenakis, che lo approfondì a cavallo fra gli anni cinquanta e sessanta.

MA PRECISAMENTE, QUALI SONO LE SUE ORIGINI?

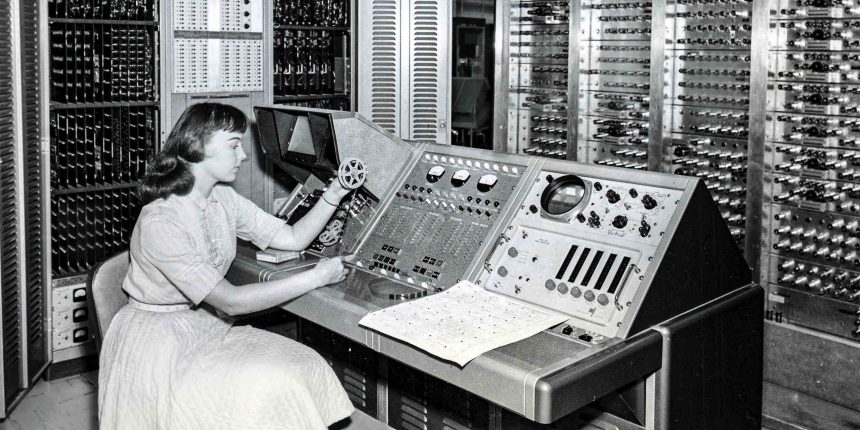

Nel 1945 le uniche macchine in grado di eseguire processi computazionali avevano dimensioni eccessive e funzionavano secondo principi elettromeccanici. Un punto importante fu l’equivalenza dimostrata nel 1938 dal giapponese Akira Nakajima, tra i circuiti elettrici di commutazione (on/off) e la logica booleana. In origine questi computer non erano “programmabili”, ma il primo computer fu lo Z3 costruito da Konrad Zuse a Berlino. L’era dei computer elettronici programmati da software iniziò con l’UNIVAC I (1951) e l’IBM 701 (1952), sistemi basati su valvole termoioniche ma già equivalenti ai computer generici. L’IBM 701 è un esempio di architettura di progettazione sviluppata dal matematico John von Neumann dell’Institute for Advanced Study dell’Università di Princeton. Nel 1954, i Bell Labs costruirono il computer a transistor TRADIC, senza l’uso di valvole a vuoto.

I LABORATORI BELL

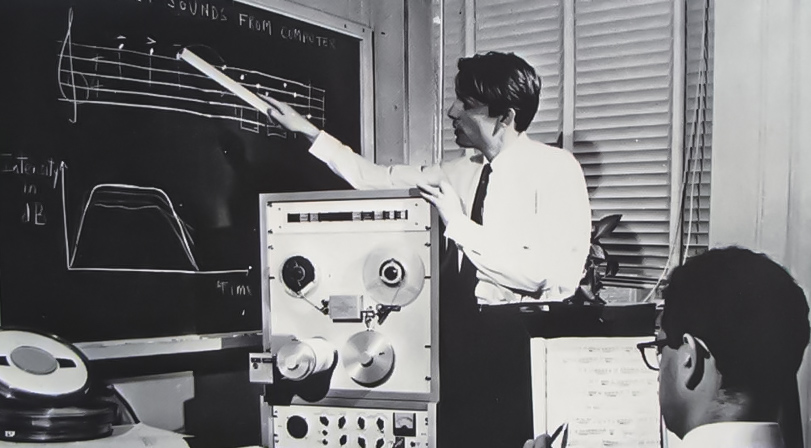

Gli sviluppi decisivi nel campo dell’audio digitale, o meglio di rappresentazione numerica del suono e dell’ informatica musicale, avvennero presso i Bell Labs nella seconda metà degli anni ’50, luogo che divenne il centro di ricerca scientifica e tecnologica di livello mondiale. In questi anni si pensava di applicare i metodi allora in uso, ampliati alla codifica e allo studio dei segnali di comunicazione telefonica. Una riproduzione chiara del parlato su un telefono richiede una “frequenza di campionamento” di diversi kHz, sufficiente a coprire le prime due o tre formanti dello spettro vocale umano. Nel 1957, Guttman e Matthews programmarono il mainframe a valvole IBM 704 per produrre un segnale digitale corrispondente alle note di una breve melodia composta da Guttman (Silver Scale), per un totale di 17 secondi di musica. Questa è stata la prima volta che un segnale udibile è stato sintetizzato da un computer elettronico collegato a un convertitore di segnale da digitale ad analogico, applicando le leggi della teoria dell’informazione di Shannon.

The silver scale

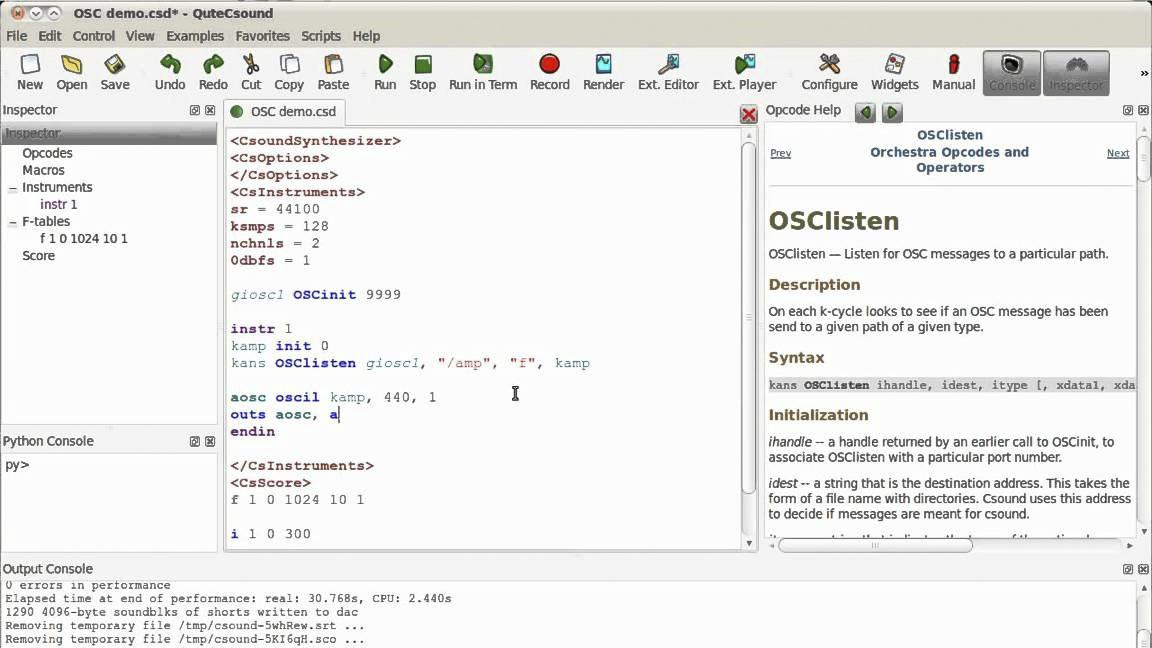

Il programma preparato nel 1957 si chiamava MUSIC I (Music One): produceva un segnale ad onda triangolare, la cui frequenza poteva essere determinata. Nel 1958 fu la volta di MUSIC II (Music two), che girava sull’IBM 709 e permetteva la sintesi simultanea di quattro suoni. Nel 1960, Mathews sviluppò MUSIC III (Music three) sul computer IBM 7090 di “nuova generazione”, che si utilizzava come un sistema di programmazione seguendo una serie di standard che potevano essere scambiati in un’unica variabile numerica, come ad esempio:

1. istruzioni che descrivono gli algoritmi di sintesi del suono

2. istruzioni che calcolano e memorizzano funzioni d’onda e funzioni di controllo

3. istruzioni per ricordare l’algoritmo di sintesi basato su un elenco di tempi

Per ampliare il suo software, Mathews sentì il bisogno di coinvolgere dei veri musicisti: nel 1961, James Tenney iniziò a lavorare presso i Bell Labs. I canadesi realizzarono quella che dovrebbe essere considerata la prima musica realmente generata dal computer in pochi mesi, e quella fu Analog #1 (Noise Study).

Analog #1 (Noise Study)

Nel 1963 e 1964 terminò la MUSIC IV, introducendo sufficienti funzionalità non solo per la sintesi sonora, ma anche per lo sviluppo di strutture compositive, con la possibilità di organizzare automaticamente dati musicalmente significativi. Esso fu capostipite di una vera e propria “famiglia” di sintesi sonora e linguaggi di programmazione di elaborazione. In seguito ci fu MUSIC IV-BF in esecuzione sull’IBM 7094 nel 1967, la cui conversione in analogico e registrazione su nastro, avvenne presso i Bell Labs.

D’altra parte, MUSIC V è stato originariamente scritto in Fortran (mainframe General Electric GE 645). Si è affermato come lo standard decisivo per la sintesi digitale del suono in tempi differenti. Nel 1968, Jean-Claude Risset produsse una serie di esempi sintetici basati su MUSIC V e li pubblicò come “Introduction to Computer Synthesized Sound”.

Gli opcode e il generatore di unità di MUSIC V consentirono la creazione di oscillatori software, filtri, operatori matematici, controlli di ampiezza e frequenza e generatori di rumore. In effetti, fu un esempio dello sviluppo di altri sistemi di programmazione audio, come CMUSIC, sviluppato in C da Richard Moore nel Computer Audio Research Laboratory nel 1980. Nel tempo è rimasto disponibile su numerose piattaforme di calcolo tutt’oggi in funzione su microcomputer, come la versione MUSIC V del LMA-CNRS di Marsiglia e il CSC dell’Università di Padova.

Osserviamo come l’inizio della sintesi digitale e i primi tentativi di registrazione digitale, avvennero molto presto: tra il 1967 e il 1969, i ricercatori del Tokyo NHK (servizio pubblico di radiodiffusione e televisione giapponese) costruirono un registratore audio digitale stereo, che utilizzava la videocassetta come sostegno. Inoltre nel 1970 Thomas Stockham, docente dell’Università dello Utah, creò un registratore digitale capace anche di editare il segnale presente.

In una fase successiva, il segnale digitale venne quindi convertito in un segnale analogico, dove era disponibile un dispositivo di conversione digitale-analogico (DAC). Così il segnale poteva finalmente raggiungere il registratore o gli altoparlanti per trasformarsi in suono.

Per descrivere il primo esempio di composizione al computer, è utile precisare il significato di alcune categorie generali. Sin dall’inizio ci sono state due direzioni di ricerca:

• “Composizione algoritmica”: formalizzazione informatica della struttura musicale di un repertorio o di una nuova composizione per esecuzione strumentale o vocale;

• “Sintesi sonora ed elaborazione digitale”: creazione e variazione al computer di segnali sonori, strutturati in forme musicali.

COMPOSIZIONE ALGORITMICA

L’invenzione dei programmi formali, gli “algoritmi” che determinano la struttura di un brano musicale, è stata uno dei principali punti di interesse nel campo della computer music sin dalla sua nascita. Esistono due approcci generali: uno più vicino alla teoria musicale popolare e l’altro più legato alla sperimentazione musicale.

Durante il 1955, prima che Max Mathews intraprendesse la sua ricerca presso i Bell Labs, Hiller e Isaacson avevano iniziato a scrivere un computer mainframe chiamato ILLIAC (Illinois Automatic Computer). Modificarono la struttura musicale con modelli statistici, utilizzando generatori di numeri casuali, regole di selezione e metodi casuali. Nel 1956 apparvero numerose composizioni musicali, presentate in occasione di concerti, in primis le prime composizioni effettivamente ottenute da un computer, ovvero la prima forma di “musica algoritmica”.

Illiac suite

Un approccio algoritmico alla composizione fu quello del celebre violoncellista Pietro Grossi (1917-2002). Il suo primo approccio alle risorse informatiche risale al 1961, presso il Dipartimento di Matematica dell’Università di Firenze, quando scrisse una serie di programmi FORTRAN (regole di combinazione) su un mini computer IBM 1620. Sulla base dei dati ottenuti da un computer, Grossi diresse sette oscillatori i cui suoni vennero assemblati presso lo studio S2FM di Firenze. Si concentrò poi sulla trascrizione informatica di pagine del repertorio strumentale europeo dal 1967, quando operò alla Olivetti di Pregnana Milanese utilizzando un computer General Electric GE 115. I modelli compositivi algoritmici di autori come Iannis Xenakis e Gottfried Michael Koenig o i francesi Pierre Barbaud e Michel Philippot, si basarono su regole piuttosto che su specifici modelli musicali preesistenti. Questi compositori avevano già esperienza pre-informatica ed erano abituati a darsi procedure generative precise, più o meno rigide. Xenakis utilizzava già processi probabilistici calcolati “a mano” in opere per orchestra alla fine degli anni ’50 e all’inizio degli anni ’60. Un rilevante esempio sarà Analogique A composto nel 1959, per nove strumenti ad arco. Nel 1962, tuttavia, il compositore utilizzò un IBM 7090 a Parigi ed eseguì programmi da lui scritti in un linguaggio Fortran, basati sulle regole utilizzate per la composizione. Un punto di vista simile incarna la proposta di Pierre Barbaud (1911-1990), che a sua volta utilizzò processi automatici per creare musica strumentale e fondò il GMAP (Gruppo di musica algoritmica di Parigi) nel 1959.

SINTESI NUMERICA DEL SUONO

Negli anni 60, invece, Tenney e Risset iniziarono a lavorare nei Bell Labs. Nel 1961, per ottenere Analog #1, Tenney determinò un unico processo di sintesi del suono che prevedeva la modulazione dell’ampiezza di numeri casuali controllati da un generatore; i risultati furono quindi montati su nastro. Jean-Claude Risset sviluppò un interesse per una più ampia gamma di tecniche di sintesi del suono, e fu in grado di definire con precisione le dinamiche spettrali strutturali del suono. Per Risset è stata determinante la possibilità di “comporre lo spettro” e articolare le parziali nel tempo, creando uno spazio compositivo continuo tra la struttura musicale armonica e lo spettro sonoro. Gli studi informatici sul timbro degli strumenti musicali furono per lui importanti: lo scopo non era l’imitazione, ma la comprensione dei criteri psicoacustici che stanno alla base della percezione umana del timbro.

Egli compose due lavori principali ai laboratori Bell: Mutations e Computer suite for Little Boy. Il primo fu più convincente grazie alla sua semplicità; il secondo invece era più articolato ma limitato.

In seguito ebbe importanti collaborazioni con Parigi: a metà degli anni ’70 fu coinvolto nella realizzazione dell’IRCAM di Pierre Boulez a Parigi, insieme a Luciano Berio e Max Mathews) e in questo contesto produsse alcuni dei suoi lavori più importanti, come Inharmoniques e Songes, entrambi creati con MUSIC V. Quest’ultima, sviluppata all’IRCAM, fu dotata della possibilità di acquisire registrazioni digitali. In Songes, infatti, lo studio della composizione timbrica va in due direzioni opposte: da un lato brevi registrazioni strumentali formano una “melodia di timbri”; dall’altro ci sono suoni sintetici che evocano campane con naturalismo.

Inharmoniques

Songes

DIREZIONI DIVERSE DELLA MUSICA INFORMATICA INTEGRAZIONE DI COMPOSIZIONE ALGORITMICA E SINTESI DEL SUONO

Nella concretizzazione di Quartet in paris, opera dell’americano James Randall, i computer vennero utilizzati sia per codificare strutture musicali continue sia per sintetizzare i suoni stessi, utilizzando tecniche di sintesi di forme d’onda fisse. Il collegamento era semplice: la selezione del timbro era controllata da processi seriali che informavano la struttura delle altezze musicali.

In altri autori, i due strati sembrano intrecciarsi ancora di più, fino quasi a confondersi, poiché suono e musica sono in realtà formati dagli stessi standard operativi. In Analog #1 ad esempio, la raccolta dei singoli eventi sonori, e le macrostrutture in cui essi si collocano, sono regolate dalle stesse regole, in scale temporali differenti. Mentre per Risset e Chowning il computer elaborava nuove sonorità, per Brün il suono venne trattato come risultato di un processo combinatorio applicato ad un processo di sintesi del suono disegnato secondo logiche indipendenti rispetto a modelli acustici o percettivi noti.

Con Koenig, negli anni ‘70, la sintesi numerica venne creata attraverso procedure SSP (Sound Synthesis Program) in una forma non standard. Queste tecniche di sintesi digitale portarono ad uno sviluppo molto significativo, infatti eliminarono la distinzione tra la descrizione del suono, ovvero l’algoritmo di sintesi, e la descrizione della struttura musicale ovvero la composizione algoritmica.

L’ultimo esempio di sintesi numerica fu quello di Iannis Xenakis. Nel 1972 il compositore greco-francese fondò a Parigi il CEMAMu (centro per gli studi di matematica, automazione e musica) con altri ricercatori universitari. Xenakis applicò alla sintesi sonora gli stessi criteri che utilizzò nella “musica stocastica” nel corso degli anni; inoltre vide la sintesi come una combinazione microscopica governata dalle leggi del cambiamento statistico, con vari gradi di ordine e disordine e chiamò il suo metodo di sintesi numerica dei suoni “sintesi casuale dinamica”.

Quindici anni dopo tornò a lavorare per Gendy3 (1991), che in un certo senso rappresenta il suo approccio alla tecnologia dell’informazione. Per fare ciò, infatti, utilizzò una procedura probabilistica per sintetizzare il suono e per articolare ciascuna delle 11 parti della composizione.

Xenakis ebbe uno sviluppo in campo informatico: nel 1977 portò a termine il sistema Upic (unità poliagogica interattiva del CEMAMu),che consentiva di trasformare delle linee rette e curve in suoni attraverso un minicomputer composto da oscillatori digitali e dati grafici: la traccia poi poteva essere compresa dal computer come glissati, inviluppi, algoritmi ecc.

COMPOSITORI MUSIC AMERICANA

Il nome di John Chowning è spesso collegato alla tecnica di sintesi digitale del suono mediante modulazione di frequenza, ebbe come tutor Leland Smith, che lo aveva introdotto all’informatica e dell’audio digitale, e che nel 1964 lo aveva spedito a studiare con Max Mathews. Nel 1967, alle prese con MUS 10 (il software scritto da lui) Chowning indagava il tipico “vibrato” di certi stili di canto: per errore gli capitò di dare al computer un valore di frequenza di vibrato più grande del necessario (di solito si tratta di circa 5/6 Hz), con esiti piuttosto sorprendenti; attraverso un amico ingegnere, George Gucker, egli compreso che il fenomeno era assimilabile alla“modulazione di frequenza” (FM). Chowning decise di approfondire e imparò a controllare il processo, ottenendo suoni di spettro dinamico complesso con sforzo computazionale molto contenuto (bastavano due oscillatori sinusoidali e qualche variabile di controllo): era una procedura assai meno dispendiosa rispetto alla sintesi additiva e altre tecniche usate nella sperimentazione e nell’industria degli strumenti musicali elettronici del tempo. Fu questo che motivò la ricerca ulteriore sulla sintesi digitale FM, e che spiega come mai i primi sintetizzatori digitali prodotti a scala industriale usassero questa particolare tecnica: si potevano trarne suoni timbricamente complessi con poche risorse di calcolo, anche in tempo reale. Chowning fu il primo a sviluppare al computer algoritmi di spazializzazione e distribuzione dinamica del suono su molteplici altoparlanti, e implementò le prime forme di simulazione digitale di fenomeni di riverberazione. Questi interessi di ricerca sono tutti ben presenti nelle opere di computer music di Chowning, almeno a partire da Turenas (suoni di sintesi su nastro magnetico quadrifonico, 1972). Tutti i suoni di Turenas (anagramma della parola “natures”) furono ottenuti con modulazione di frequenza e furono gestiti secondo una distribuzione spaziale dinamica su quattro altoparlanti, con simulazione di sorgenti di movimento nello spazio lungo traiettorie disegnate in fase di composizione.

Dashow collaborò con MUSIC IV – BF in Whispers out of time (suono sintetico su nastro, 1975-1976) e Side Effects (clarinetto e suono sintetico su nastro, 1976), considerata la prima musica italiana generata al computer. Tra i primi sistemi ibridi sviluppati alla fine degli anni ’60 (in cui i computer venivano spesso utilizzati come controlli per dispositivi sintetici analogici in tempo reale), ricordiamo GROOVE (“Generazione di operazioni in tempo reale su dispositivi a controllo di tensione”) progettato da Max Mathews e Richard Moore ai laboratori bell.

Il primo e più complesso sistema di calcolo numerico sintetico in tempo reale è stato progettato dal fisico Giuseppe Di Giugno (1937). Il processore 4A, costruito da Di Giugno all’Università di Napoli nel 1975, era essenzialmente un insieme di oscillatori digitali in hardware che dovevano essere controllati da un computer esterno. Il dispositivo, in grado di attivare fino a 256 oscillatori contemporaneamente, suscitò l’interesse di Luciano Berio, che fu coinvolto nella fondazione dell’IRCAM a Parigi. L’IRCAM (Institut de Recherche et Coordination Acoustique/Musique) aprì ufficialmente nel 1977 dopo aver attraversato un percorso organizzativo.

Fu ideato e fortemente voluto dal compositore e direttore d’orchestra Pierre Boulez (1925-2016). Boulez la vide come un’istituzione pubblica destinata alla ricerca musicale (con un significato diverso dal concetto di sperimentazione musicale). Deluso dalla sua prima esposizione all’elettronica negli anni ’50, Boulez maturò da tempo in un progetto con un team interdisciplinare e altamente qualificato che combinò saldamente competenze artistiche e tecnico-scientifiche. Fu con questo spirito che istituì l’IRCAM, di cui fu direttore fino al 1992. A metà degli anni ’70, Di Giugno entrò a far parte dell’IRCAM su invito di Boulez e Berio. Alla fine degli anni ’70, Di Giugno progettò una serie di sistemi hardware sempre più performanti. Lo studio della computer music americana degli anni ‘60 consente di conoscere il percorso evolutivo che la musica ha avuto grazie all’apporto dei nuovi strumenti elettronici. Lo scopo di quest’articolo, è proprio quello di comprendere il cambiamento del modo di comporre e di eseguire odierno, rispetto al passato. Inoltre, evidenzia come sia significativo il dialogo tra tecnologia e musica nel momento in cui la prima, fornisce al linguaggio musicale strumenti per la scoperta di orizzonti espressivi in linea con le nuove sensibilità.

Bibliografia

Circuiti del tempo. Un percorso storico-critico nella creatività musicale elettroacustica e informatica Autore: prof. Agostino Di Scipio

Articolo realizzato dagli allievi del Liceo Musicale G.M. Galanti di Campobasso nell’ambito del PERCORSO PCTO.

Cristofano Giulia

Petrillo Valeria

Romano Maria Michela